EY: sztuczna inteligencja oznacza wyzwania etyczne i legislacyjne

2020-08-12 10:32

Przeczytaj także: Etyczne AI buduje zaufanie i lojalność klienta

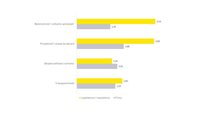

Wprawdzie o zaletach sztucznej inteligencji mówi się znacznie więcej niż o jej wadach, to jednak coraz częściej zaczyna się zwracać uwagę właśnie na zjawiska niepożądane, w tym np. na stronnicze lub niesprawiedliwe traktowanie ludzi. Okazuje się jednak, że nie wszyscy traktują te kwestie w sposób priorytetowy. Rozdźwięk widoczny jest zwłaszcza pomiędzy opiniami firm a regulatorów.W opinii przebadanych decydentów, przy wykorzystaniu sztucznej inteligencji w rozwiązaniach rozpoznających twarz zdecydowanie najistotniejszymi kwestiami natury etycznej są bezstronność i unikanie uprzedzeń, których waga została oceniona na 3.14 pkt. Dla porównania, firmy dały temu zagadnieniu 1.34 pkt, plasując je dopiero na szóstej pozycji. W ich opinii najważniejsza okazała się bowiem prywatność i prawa do danych. To zagadnienie znalazło się również wysoko - bo na drugim miejscu - wśród decydentów, choć zdecydowanie inaczej rozłożyły się punktacje. Decydenci ocenili ważność tej kwestii na 3.09 pkt a firmy na 1.88 pkt.

Bezpieczeństwo i ochrona to z kolei druga pod względem ważności etycznych kwestii, które zdaniem firm wymagają uwagi przy rozwiązaniach wykorzystujących sztuczną inteligencję do rozpoznawania twarzy. Pierwszą trójkę priorytetów dla obu badanych grup zamyka transparentność.

fot. mat. prasowe

Rozpoznawanie twarzy w celu kontroli: legislatorzy i regulatorzy vs. firmy

Bezstronność i unikanie uprzedzeń to kwestia, której legislatorzy i regulatorzy przyznają priorytet

Firmy i decydenci różnią się jednak nie tylko wskazaniami najważniejszych do uregulowania kwestii w zakresie zastosowania sztucznej inteligencji, ale w badaniu widać również, że inne jest samo podejście do wyzwań etycznych stawianych przez AI. Podczas gdy decydenci wyraźnie identyfikują kilka najważniejszych do uregulowania obszarów i nadają im największą wagę, firmy nie polaryzują tak wyraźnie wyzwań.

Zdaniem Justyny Wilczyńskiej-Baraniak, Lidera Zespołu Własności Intelektualnej, Technologii i Danych Osobowych w Kancelarii EY Law wynika to z tego, że firmom trudno jest nadawać priorytet któremukolwiek z wyzwań etycznych, ponieważ są one dla nich równoważne

Definiując wyzwania etyczne, przedsiębiorcy mają na uwadze kwestie techniczne, implementacyjne i biznesowe, które nie znajdują się na radarach decydentów - podkreśla Justyna Wilczyńska-Barania. - Rozdźwięk między ryzykami dostrzeganymi przez legislatorów i regulatorów a firmami wynika więc przede wszystkim z innej perspektywy postrzeganych wyzwań. Trzeba pamiętać, że decydenci patrzą na nie zdecydowanie szerzej, mając na uwadze szerszą grupę interesariuszy. Firmy koncentrują się przede wszystkim na wyzwaniach – w tym biznesowych - dla nich samych i branż, w których działają dodaje.

Różne punkty widzenia na najistotniejsze do rozwiązania kwestie etyczne związane z rozwojem sztucznej inteligencji to istotne wyzwanie legislacyjne. 55% ankietowanych przedsiębiorców wykorzystujących technologię AI oczekuje, że zostanie stworzony jeden zestaw uniwersalnych zasad, na który zgodzi się większość krajów i który będzie łatwy do zaimplementowania, niezależnie od jurysdykcji. Tak optymistyczni nie są jednak ci, którzy te zasady będą tworzyć. Tylko 21% decydentów spodziewa się takiego rozwiązania, natomiast większość – 66% uważa, że jeden zestaw uniwersalnych zasad powstanie, ale poszczególne kraje będą go implementować w zależności od własnych uwarunkowań. Ankietowani przedstawiciele firm niemal dwukrotnie częściej niż przedstawiciele legislatorów i regulatorów wskazywali również, że poszczególne kraje bądź regiony stworzą własne zasady etyczne.

Co więcej, 6 na 10 przedstawicieli firm uważa, że znacznie korzystniejszym rozwiązaniem byłoby stworzenie tych zasad przez samych zainteresowanych, czyli firmy i branże, które sztuczną inteligencję wykorzystują na co dzień w swojej działalności. Z taką tezą zgadza się natomiast wyłącznie 24% decydentów.

Metodologia badania

Badanie EY i The Future Society zostało przeprowadzone pod koniec 2019 i na początku 2020 roku w 55 krajach, wśród 71 legislatorów, regulatorów i doradców w zakresie sztucznej inteligencji oraz 284 firm wykorzystujących tę technologię. Ankietowani proszeni byli o wskazanie i uszeregowanie 11 najważniejszych zagadnień etycznych w odniesieniu do 12 rozwiązań technologicznych wykorzystujących sztuczną inteligencję.

![Jak budować zaufanie do sztucznej inteligencji? [© fotomek - Fotolia.com] Jak budować zaufanie do sztucznej inteligencji?](https://s3.egospodarka.pl/grafika2/sztuczna-inteligencja/Jak-budowac-zaufanie-do-sztucznej-inteligencji-234270-150x100crop.jpg) Jak budować zaufanie do sztucznej inteligencji?

Jak budować zaufanie do sztucznej inteligencji?

oprac. : eGospodarka.pl

Przeczytaj także

Skomentuj artykuł Opcja dostępna dla zalogowanych użytkowników - ZALOGUJ SIĘ / ZAREJESTRUJ SIĘ

Komentarze (0)

Najnowsze w dziale Wiadomości

-

![Kobiety na rynku pracy: mniejsze ambicje czy większe bariery? [© Freepik] Kobiety na rynku pracy: mniejsze ambicje czy większe bariery?]()

Kobiety na rynku pracy: mniejsze ambicje czy większe bariery?

-

![KLM wprowadza taryfę "basic" bez bagażu podręcznego - podróż tylko z małą torbą pod fotel [© wygenerowane przez AI] KLM wprowadza taryfę "basic" bez bagażu podręcznego - podróż tylko z małą torbą pod fotel]()

KLM wprowadza taryfę "basic" bez bagażu podręcznego - podróż tylko z małą torbą pod fotel

-

![Pokolenie Z w pracy: jak różnią się priorytety i oczekiwania młodych pracowników w Polsce [© wygenerowane przez AI] Pokolenie Z w pracy: jak różnią się priorytety i oczekiwania młodych pracowników w Polsce]()

Pokolenie Z w pracy: jak różnią się priorytety i oczekiwania młodych pracowników w Polsce

-

![Nie tylko cena. Co naprawdę przyciąga klientów i buduje ich lojalność? [© Freepik] Nie tylko cena. Co naprawdę przyciąga klientów i buduje ich lojalność?]()

Nie tylko cena. Co naprawdę przyciąga klientów i buduje ich lojalność?

![EY: sztuczna inteligencja oznacza wyzwania etyczne i legislacyjne [© Igor Mojzes - Fotolia.com] EY: sztuczna inteligencja oznacza wyzwania etyczne i legislacyjne](https://s3.egospodarka.pl/grafika2/sztuczna-inteligencja/EY-sztuczna-inteligencja-oznacza-wyzwania-etyczne-i-legislacyjne-231610-200x133crop.jpg)

![Sztuczna inteligencja musi być etyczna [© Jakub Jirsák - Fotolia.com] Sztuczna inteligencja musi być etyczna](https://s3.egospodarka.pl/grafika2/sztuczna-inteligencja/Sztuczna-inteligencja-musi-byc-etyczna-210598-150x100crop.jpg)

![DeepSeek zagrożeniem dla prywatności? Europa blokuje chińską aplikację AI, Polska czeka, eksperci ostrzegają [© wygenerowane przez AI] DeepSeek zagrożeniem dla prywatności? Europa blokuje chińską aplikację AI, Polska czeka, eksperci ostrzegają](https://s3.egospodarka.pl/grafika2/DeepSeek/DeepSeek-zagrozeniem-dla-prywatnosci-Europa-blokuje-chinska-aplikacje-AI-Polska-czeka-eksperci-ostrzegaja-267771-150x100crop.png)

![Nowa era AI: Grok 4.0 wyprzedza GPT-4o i Claude Opus 4 w kluczowych testach [© wygenerowane przez AI] Nowa era AI: Grok 4.0 wyprzedza GPT-4o i Claude Opus 4 w kluczowych testach](https://s3.egospodarka.pl/grafika2/Grok/Nowa-era-AI-Grok-4-0-wyprzedza-GPT-4o-i-Claude-Opus-4-w-kluczowych-testach-267717-150x100crop.png)

![Sztuczna inteligencja zmienia SEO: Jak GEO wpływa na widoczność marki w internecie [© wygenerowane przez AI] Sztuczna inteligencja zmienia SEO: Jak GEO wpływa na widoczność marki w internecie](https://s3.egospodarka.pl/grafika2/sztuczna-inteligencja/Sztuczna-inteligencja-zmienia-SEO-Jak-GEO-wplywa-na-widocznosc-marki-w-internecie-267663-150x100crop.png)

![Cyberzagrożenia na wakacjach: porty USB, kody QR, Wi-Fi i fałszywe strony - jak się chronić? [© wygenerowane przez AI] Cyberzagrożenia na wakacjach: porty USB, kody QR, Wi-Fi i fałszywe strony - jak się chronić?](https://s3.egospodarka.pl/grafika2/cyberbezpieczenstwo/Cyberzagrozenia-na-wakacjach-porty-USB-kody-QR-Wi-Fi-i-falszywe-strony-jak-sie-chronic-267662-150x100crop.png)

![Nowości Google: AI i VEO 3 zmieniają strategie PPC w e-commerce [© wygenerowane przez AI] Nowości Google: AI i VEO 3 zmieniają strategie PPC w e-commerce](https://s3.egospodarka.pl/grafika2/AI/Nowosci-Google-AI-i-VEO-3-zmieniaja-strategie-PPC-w-e-commerce-267571-150x100crop.png)

![Sztuczna inteligencja napędza cyberataki - nowe zagrożenia dla firm [© wygenerowane przez AI] Sztuczna inteligencja napędza cyberataki - nowe zagrożenia dla firm](https://s3.egospodarka.pl/grafika2/AI/Sztuczna-inteligencja-napedza-cyberataki-nowe-zagrozenia-dla-firm-267532-150x100crop.png)

![Dlaczego jedne firmy zyskują na AI, a inne nie potrafią jej wykorzystać? [© wygenerowane przez AI] Dlaczego jedne firmy zyskują na AI, a inne nie potrafią jej wykorzystać?](https://s3.egospodarka.pl/grafika2/AI/Dlaczego-jedne-firmy-zyskuja-na-AI-a-inne-nie-potrafia-jej-wykorzystac-267501-150x100crop.png)

![AI zmanipulowane przez złośliwe oprogramowanie. Czy to nowa era cyberataków? [© wygenerowane przez AI] AI zmanipulowane przez złośliwe oprogramowanie. Czy to nowa era cyberataków?](https://s3.egospodarka.pl/grafika2/AI/AI-zmanipulowane-przez-zlosliwe-oprogramowanie-Czy-to-nowa-era-cyberatakow-267404-150x100crop.png)

![Rynek pracy: panuje względny optymizm, 69% pracowników nie boi się bezrobocia [© Sergey Nivens - Fotolia.com] Rynek pracy: panuje względny optymizm, 69% pracowników nie boi się bezrobocia](https://s3.egospodarka.pl/grafika2/rynek-pracy/Rynek-pracy-panuje-wzgledny-optymizm-69-pracownikow-nie-boi-sie-bezrobocia-231621-150x100crop.jpg)

![Kobiety na rynku pracy: mniejsze ambicje czy większe bariery? [© Freepik] Kobiety na rynku pracy: mniejsze ambicje czy większe bariery?](https://s3.egospodarka.pl/grafika2/kobiety-na-rynku-pracy/Kobiety-na-rynku-pracy-mniejsze-ambicje-czy-wieksze-bariery-267825-150x100crop.jpg)

![KLM wprowadza taryfę "basic" bez bagażu podręcznego - podróż tylko z małą torbą pod fotel [© wygenerowane przez AI] KLM wprowadza taryfę "basic" bez bagażu podręcznego - podróż tylko z małą torbą pod fotel](https://s3.egospodarka.pl/grafika2/oplaty-za-bagaz/KLM-wprowadza-taryfe-basic-bez-bagazu-podrecznego-podroz-tylko-z-mala-torba-pod-fotel-267820-150x100crop.png)

![Pokolenie Z w pracy: jak różnią się priorytety i oczekiwania młodych pracowników w Polsce [© wygenerowane przez AI] Pokolenie Z w pracy: jak różnią się priorytety i oczekiwania młodych pracowników w Polsce](https://s3.egospodarka.pl/grafika2/pokolenie-Z/Pokolenie-Z-w-pracy-jak-roznia-sie-priorytety-i-oczekiwania-mlodych-pracownikow-w-Polsce-267818-150x100crop.png)

![Nie tylko cena. Co naprawdę przyciąga klientów i buduje ich lojalność? [© Freepik] Nie tylko cena. Co naprawdę przyciąga klientów i buduje ich lojalność?](https://s3.egospodarka.pl/grafika2/zachowania-konsumentow/Nie-tylko-cena-Co-naprawde-przyciaga-klientow-i-buduje-ich-lojalnosc-267776-150x100crop.jpg)

![Ranking kredytów i pożyczek konsolidacyjnych [© Africa Studio - Fotolia.com] Ranking kredytów i pożyczek konsolidacyjnych](https://s3.egospodarka.pl/grafika2/kredyt-konsolidacyjny/Ranking-kredytow-i-pozyczek-konsolidacyjnych-203373-150x100crop.jpg)

![Skuteczny artykuł sponsorowany - jak napisać i gdzie publikować? [© Tierney - Fotolia.com] Skuteczny artykuł sponsorowany - jak napisać i gdzie publikować?](https://s3.egospodarka.pl/grafika2/artykul-sponsorowany/Skuteczny-artykul-sponsorowany-jak-napisac-i-gdzie-publikowac-216067-150x100crop.jpg)

![Działalność nierejestrowana - wyższy limit przychodu w 2024 roku [© patpitchaya - Fotolia.com] Działalność nierejestrowana - wyższy limit przychodu w 2024 roku](https://s3.egospodarka.pl/grafika2/dzialalnosc-nierejestrowa/Dzialalnosc-nierejestrowana-wyzszy-limit-przychodu-w-2024-roku-257135-150x100crop.jpg)

![Wakacyjny detoks cyfrowy – ilu Polaków rezygnuje z internetu na urlopie? [© Freepik] Wakacyjny detoks cyfrowy – ilu Polaków rezygnuje z internetu na urlopie? [© Freepik]](https://s3.egospodarka.pl/grafika2/korzystanie-z-internetu/Wakacyjny-detoks-cyfrowy-ilu-Polakow-rezygnuje-z-internetu-na-urlopie-267725-50x33crop.jpg) Wakacyjny detoks cyfrowy – ilu Polaków rezygnuje z internetu na urlopie?

Wakacyjny detoks cyfrowy – ilu Polaków rezygnuje z internetu na urlopie?

![Produkcja za granicą? Tak polskie firmy reagują na nowe cła [© Freepik] Produkcja za granicą? Tak polskie firmy reagują na nowe cła](https://s3.egospodarka.pl/grafika2/polskie-firmy/Produkcja-za-granica-Tak-polskie-firmy-reaguja-na-nowe-cla-267826-150x100crop.jpg)

![Bezpieczna współpraca B2B: scoring finansowy krok po kroku [© Freepik] Bezpieczna współpraca B2B: scoring finansowy krok po kroku](https://s3.egospodarka.pl/grafika2/open-banking/Bezpieczna-wspolpraca-B2B-scoring-finansowy-krok-po-kroku-267822-150x100crop.jpg)

![Jak podatek Belki powiększa straty posiadaczy lokat bankowych [© wygenerowane przez AI] Jak podatek Belki powiększa straty posiadaczy lokat bankowych](https://s3.egospodarka.pl/grafika2/podatek-Belki/Jak-podatek-Belki-powieksza-straty-posiadaczy-lokat-bankowych-267821-150x100crop.png)

![Rzeczywisty właściciel w podatku u źródła - kluczowe objaśnienia MF po latach oczekiwania [© wygenerowane przez AI] Rzeczywisty właściciel w podatku u źródła - kluczowe objaśnienia MF po latach oczekiwania](https://s3.egospodarka.pl/grafika2/beneficjent-rzeczywisty/Rzeczywisty-wlasciciel-w-podatku-u-zrodla-kluczowe-objasnienia-MF-po-latach-oczekiwania-267819-150x100crop.png)

![Test Ford Ranger MS-RT - sportowy pick-up z charakterem i mocnym dieslem [© Wojciech Krzemiński] Test Ford Ranger MS-RT - sportowy pick-up z charakterem i mocnym dieslem](https://s3.egospodarka.pl/grafika2/Ford-Ranger/Test-Ford-Ranger-MS-RT-sportowy-pick-up-z-charakterem-i-mocnym-dieslem-267810-150x100crop.jpg)